W wyścigu o sztuczną inteligencję większe nie zawsze znaczy lepsze. Właściwie coraz częściej okazuje się, że to mniejsze modele językowe (SLM – Small Language Models) mogą być bardziej praktyczne niż ich ogromne odpowiedniki, wymagające potężnych zasobów obliczeniowych i generujące astronomiczne rachunki za energię.

Microsoft dostrzegł ten trend i zaprezentował Phi-4, najnowszą odsłonę swojej rodziny kompaktowych modeli AI, które mają łączyć wysoką wydajność z niskimi kosztami i krótkim czasem reakcji.

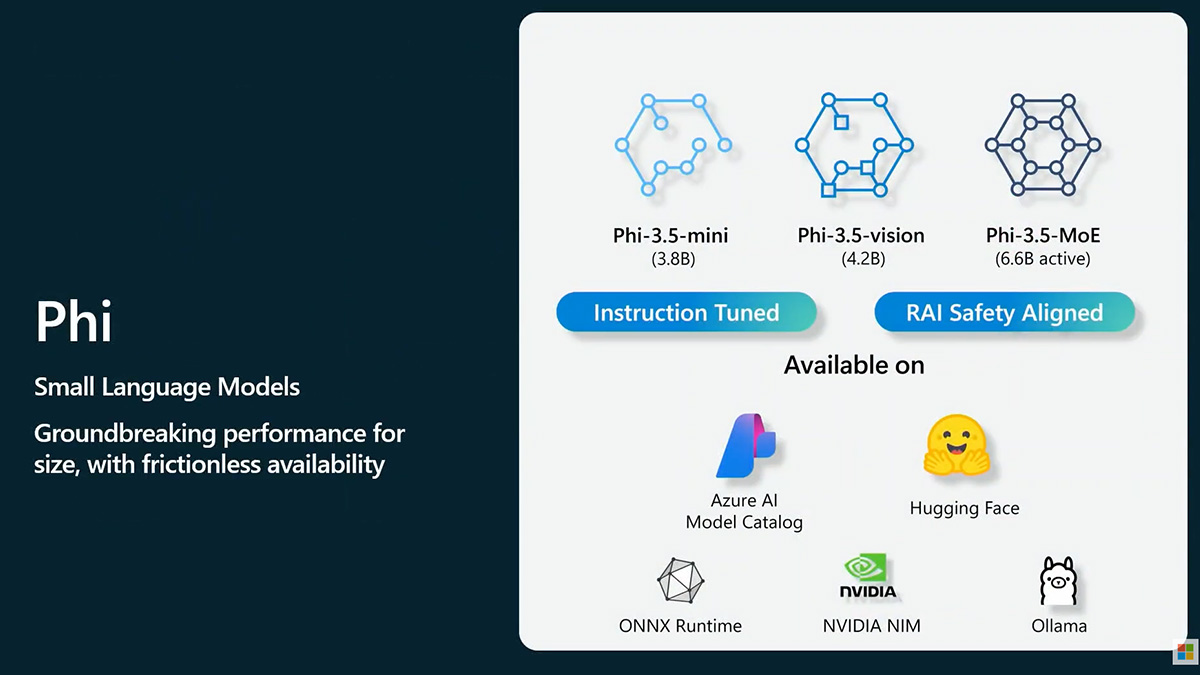

Rodzina Phi została stworzona z myślą o deweloperach poszukujących zaawansowanej AI, ale bez konieczności inwestowania w ogromne moce obliczeniowe. Nowa wersja – Phi-4 – przynosi dwa modele:

🔹 Phi-4-multimodal – obsługuje mowę, wizję i tekst jednocześnie, umożliwiając tworzenie bardziej kontekstowych i naturalnych interakcji.

🔹 Phi-4-mini – kompaktowy specjalista od zadań tekstowych, oferujący wysoką precyzję i skalowalność w niewielkiej formie.

Oba modele można już znaleźć na Azure AI Foundry, HuggingFace i w NVIDIA API Catalog.

Nowa generacja AI – szybka, tania i skuteczna

Według Weizhu Chena, wiceprezesa ds. generatywnej AI w Microsoft, Phi-4-multimodal to „kamień milowy” w rozwoju sztucznej inteligencji firmy. Model powstał w oparciu o potrzeby klientów i wykorzystuje zaawansowane techniki przetwarzania mowy, tekstu i obrazu w jednej architekturze.

– To model, który pozwala urządzeniom lepiej rozumieć i analizować wielomodalne dane w czasie rzeczywistym, przy jednoczesnej optymalizacji pod kątem wydajności na urządzeniach końcowych – podkreśla Chen.

Phi-4-multimodal może interpretować język mówiony, analizować obrazy i przetwarzać tekst jednocześnie, co otwiera drzwi do zastosowań w asystentach głosowych, analizie dokumentów czy systemach rozpoznawania mowy.

Co więcej, model radzi sobie lepiej niż niektóre większe odpowiedniki. Na liście rankingowej Huggingface OpenASR osiągnął rekordowy wynik błędu rozpoznawania słów 6,14%, pokonując dotychczasowy rekord 6,5%.

Phi-4-mini to model o 3,8 miliarda parametrów, zoptymalizowany pod kątem szybkości i skuteczności. Świetnie sprawdza się w zadaniach tekstowych, takich jak rozumowanie, matematyka, kodowanie i wykonywanie poleceń. W wielu testach prześciga większe modele, dostarczając precyzyjne i skalowalne rozwiązania.

Jego kompaktowy rozmiar sprawia, że może działać na urządzeniach o ograniczonych zasobach obliczeniowych, co czyni go atrakcyjną opcją dla firm i twórców aplikacji mobilnych.

Gdzie znajdzie zastosowanie?

Microsoft podkreśla, że dzięki mniejszym wymaganiom obliczeniowym Phi-4 może być używany w:

📱 Smartfonach – producenci mogą zintegrować model bezpośrednio w urządzeniach, bez konieczności korzystania z chmury.

🚗 Samochodach – jako zaawansowany asystent głosowy w systemach pokładowych.

🏦 Finansach – automatyzacja analiz, raportów i prognoz rynkowych.

SLM – przyszłość AI?

Phi-4 to kolejny dowód na to, że mniejsze modele AI stają się realną alternatywą dla kosztownych LLM-ów. Nie oznacza to końca wielkich modeli, ale raczej powstanie całego portfolio różnych rozwiązań, dostosowanych do konkretnych zastosowań.

Jak zauważyła Sonali Yadav, główna menedżerka produktu ds. AI w Microsoft:

– Nie chodzi o to, by porzucić duże modele na rzecz małych, ale o to, by dać klientom wybór najlepszego narzędzia dla ich potrzeb.

Nie tylko Microsoft stawia na mniejsze modele

Microsoft nie jest jedynym gigantem pracującym nad kompaktowymi modelami AI. IBM również rozwija swoją serię Granite, koncentrując się na wydajnych i skalowalnych systemach dla biznesu.

Najnowsza wersja Granite 3.2 wprowadza:

✔ Nowy model językowo-wizualny do analizy dokumentów, który dorównuje większym konkurentom.

✔ Mechanizm „chain of thought”, pozwalający na rozbijanie złożonych problemów na mniejsze kroki – podobnie jak w ludzkim rozumowaniu.

IBM poszedł o krok dalej, prezentując TinyTimeMixers – modele z mniej niż 10 milionami parametrów, które przewidują trendy w finansach i logistyce nawet na dwa lata w przód.

Jak zauważa Sriram Raghavan, wiceprezes ds. badań nad AI w IBM:

– Nowa era AI to efektywność, integracja i realny wpływ na biznes – bez konieczności przepalania ogromnych zasobów na moc obliczeniową.

Podsumowanie: Phi-4 w liczbach

📌 5,6 miliarda – liczba parametrów w modelu Phi-4-multimodal, mniej niż w większości konkurencyjnych systemów multimodalnych.

📌 6,14% – rekordowy wskaźnik błędu rozpoznawania mowy na liście OpenASR.

📌 128 000 – maksymalna długość przetwarzanej sekwencji tokenów w modelu Phi-4-mini, pozwalająca na analizę dużych dokumentów.

Czy mniejsze modele AI zrewolucjonizują rynek? Wszystko wskazuje na to, że tak. Microsoft, IBM i inni giganci technologiczni stawiają na efektywność, niski koszt i dostępność, a Phi-4 jest tego najlepszym przykładem. W końcu, jak mówi stare powiedzenie – nie liczy się rozmiar, a to, co możesz z nim zrobić. 🚀