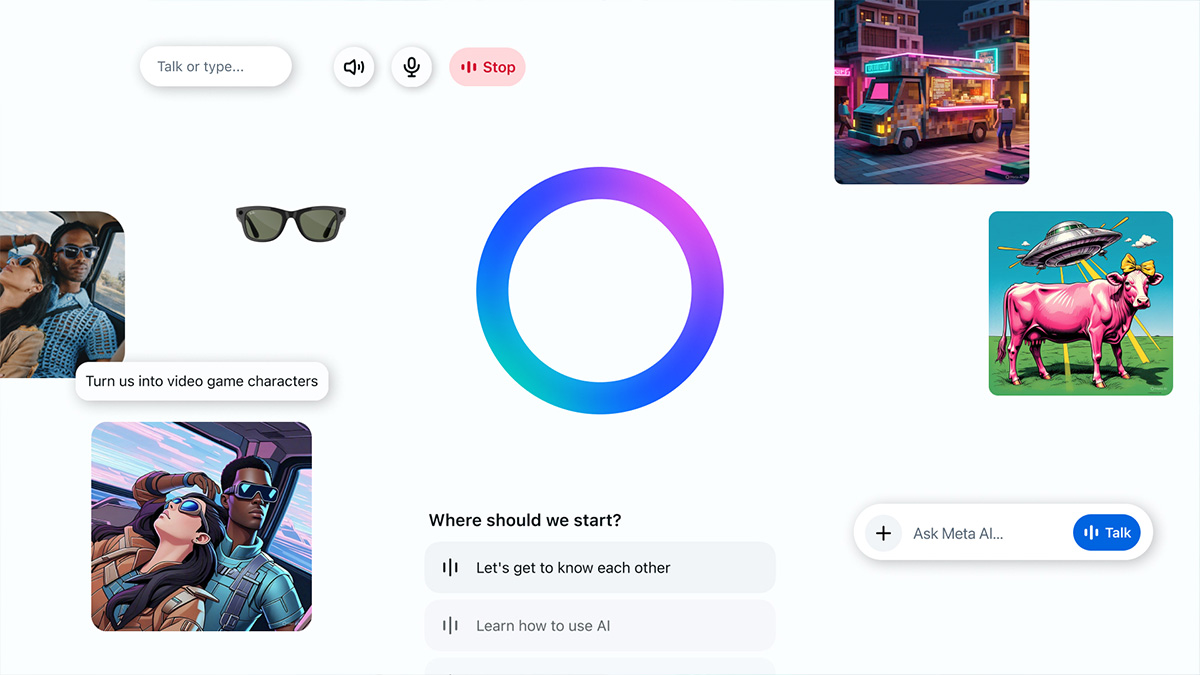

Meta wystartowała z nową aplikacją Meta AI – osobistym asystentem głosowym zbudowanym na bazie Llama 4. Co ciekawe, to nie tylko kolejna zabawka z napisem „AI”, ale pierwsza próba stworzenia sztucznej inteligencji naprawdę osobistej. Taka, która pamięta, z kim rozmawia, wie co lubisz i – przynajmniej według twórców – potrafi prowadzić rozmowę niemal jak człowiek.

Nowa aplikacja jest już dostępna w wersji testowej i można z niej korzystać niezależnie (ale w Europie z ograniczeniami) – bez potrzeby otwierania Facebooka czy Instagrama. Choć Meta AI od dawna siedzi sobie cicho gdzieś w tle Messengera czy WhatsAppa, teraz wychodzi z cienia i mówi do nas własnym głosem. Dosłownie.

Gada jak najęta

Meta AI została zaprojektowana tak, by lepiej poznawać swojego użytkownika. Im dłużej z nią rozmawiasz, tym trafniejsze i bardziej spersonalizowane odpowiedzi otrzymujesz. Interfejs? Prosty i naturalny. Obsługa? Głosowa. Ikonka mikrofonu daje znać, że AI słucha, ale też nie podsłuchuje ukradkiem – przynajmniej w teorii.

Nowy silnik Llama 4, który napędza Meta AI, został przystosowany do prowadzenia rozmów w bardziej naturalnym tonie. Asystent rozumie kontekst, potrafi generować i edytować obrazy, odpowiada na pytania, a wszystko to można wyklikać albo po prostu powiedzieć.

Coś więcej niż głos

Najciekawszą nowinką jest jednak tryb „pełnodupleksowy” – brzmi jak coś z podręcznika telekomunikacji, ale chodzi po prostu o to, że Meta AI mówi, zanim skończysz mówić ty. Nie czeka na kropkę, nie przetwarza tekstu, tylko odpowiada niemal jak człowiek. Funkcja ta działa obecnie testowo w USA, Kanadzie, Australii i Nowej Zelandii. Nie ma dostępu do internetu ani bieżących danych – to raczej przedsmak tego, co może nas czekać za rok czy dwa.

Meta AI w praktyce – od smartfona po okulary

Meta AI działa nie tylko jako osobna aplikacja, ale też integruje się z okularami Ray-Ban Meta. Rozmowę rozpoczętą głosem „na żywo” możemy kontynuować później z poziomu aplikacji lub przeglądarki internetowej. Co ciekawe – kierunek tej rozmowy działa tylko w jedną stronę. Z okularów przejdziesz do aplikacji, ale już nie odwrotnie. Przynajmniej na razie.

W ramach tej integracji Meta View – aplikacja do zarządzania inteligentnymi okularami – została połączona z Meta AI. Wszyscy dotychczasowi użytkownicy znajdą swoje urządzenia, ustawienia i dane w zakładce „Devices” nowej aplikacji.

Asystent z ambicjami

Meta AI nie ogranicza się tylko do pogaduszek o pogodzie. Może przeszukiwać internet, proponować ciekawe artykuły, podpowiadać, co obejrzeć i gdzie zjeść, a nawet generować gotowe dokumenty z tekstem i grafikami. W wybranych krajach trwają już testy nowego edytora dokumentów oraz funkcji importu plików do analizy przez AI.

A jeśli brakuje ci inspiracji – aplikacja sama podrzuca tematy do rozmowy. Ot, taki cyfrowy kumpel z niekończącą się listą ciekawostek.

Personalizacja i prywatność – duet idealny?

Meta chwali się, że jej AI zna nas jak własną kieszeń. Możemy nauczyć ją swoich preferencji, albo pozwolić, by sama się ich nauczyła na podstawie naszego profilu na Facebooku i Instagramie. Brzmi wygodnie, choć nieco złowieszczo – zwłaszcza, że mowa o firmie, która kiedyś wpadła na pomysł, by śledzić użytkowników nawet poza własnymi aplikacjami.

Na szczęście (i tu należy dodać: na razie) to użytkownik decyduje, co chce udostępnić i kiedy. Nic nie trafi do feedu bez twojej zgody – zapewnia Meta. Aplikacja ma też osobny „Discover feed”, gdzie możemy podglądać, jak inni bawią się AI, i ewentualnie skopiować ich pomysły.

Pobierz i… pogadaj

Meta AI dostępna jest już na Androida i iOS. Jeśli chcesz sprawdzić, jak brzmi głos twojego nowego cyfrowego asystenta i czy faktycznie rozumie cię lepiej niż stary kumpel z pracy – wystarczy kliknąć „pobierz”.