Google DeepMind, flagowe laboratorium badawcze AI należące do Google, rzuca wyzwanie OpenAI na polu generowania wideo. I choć walka dopiero się rozkręca, wygląda na to, że DeepMind ma szansę przynajmniej na chwilę przejąć prowadzenie.

W poniedziałek DeepMind zaprezentował Veo 2, nową wersję swojego modelu AI do generowania wideo, który jest następcą Veo. Veo 2 potrafi tworzyć klipy trwające ponad dwie minuty w rozdzielczości 4K (4096 x 2160 pikseli). To aż cztery razy wyższa rozdzielczość i ponad sześciokrotnie dłuższe klipy niż to, co obecnie oferuje konkurencyjny model OpenAI – Sora.

Jednak na razie przewaga Veo 2 pozostaje teoretyczna. Obecnie model jest dostępny wyłącznie w eksperymentalnym narzędziu VideoFX, gdzie generowane filmy ograniczono do 720p i ośmiu sekund długości (dla porównania, Sora oferuje do 1080p i 20 sekund). VideoFX jest dostępny jedynie dla wybranych użytkowników zapisanych na listę oczekujących, ale Google zapowiada rozszerzenie dostępu jeszcze w tym tygodniu.

Nowe możliwości i lepsze efekty wizualne

Co nowego wnosi Veo 2? Według DeepMind model potrafi generować wideo w różnych stylach, lepiej rozumie fizykę oraz kontrolę kamery, a same klipy mają wyraźniejszą jakość obrazu. Przykładowo, w scenach z dynamicznym ruchem tekstury i szczegóły są znacznie ostrzejsze.

Udoskonalone możliwości kontroli kamery pozwalają Veo 2 precyzyjniej ustawiać „wirtualną kamerę” oraz poruszać nią w celu uchwycenia obiektów z różnych kątów. Model lepiej symuluje także ruch, dynamikę cieczy (np. kawę nalewaną do kubka) oraz właściwości światła, takie jak cienie czy odbicia. DeepMind chwali się, że Veo 2 poradzi sobie również z bardziej skomplikowanymi efektami, jak różne typy obiektywów czy filmowe sztuczki.

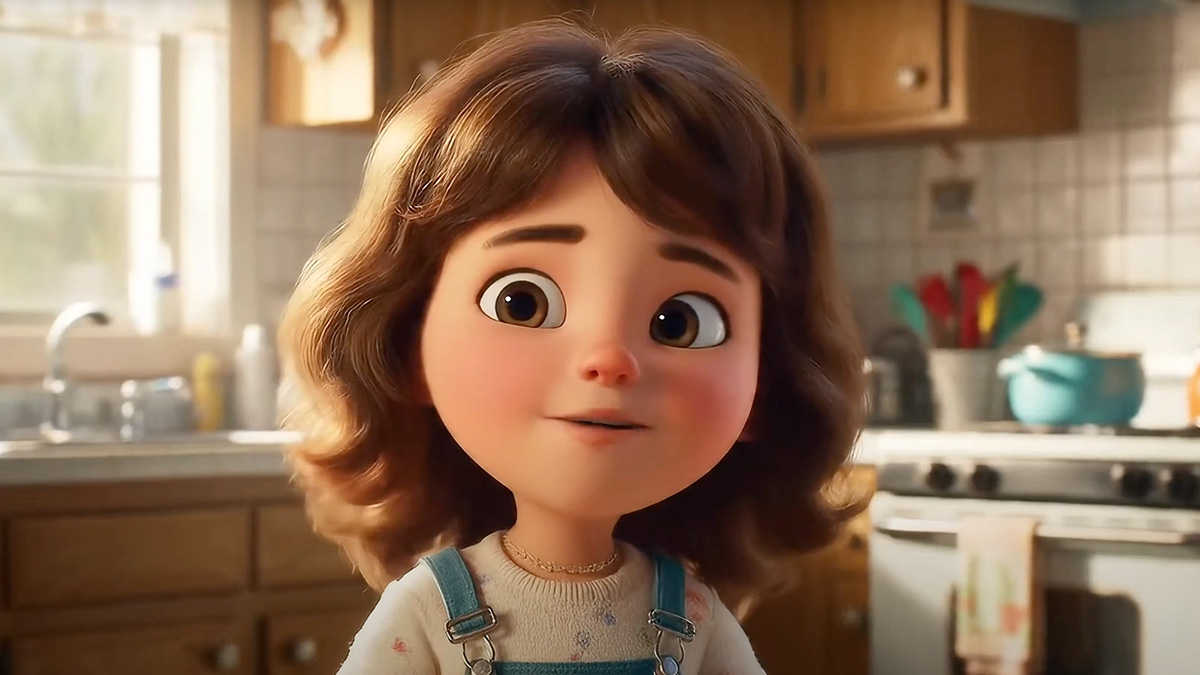

DeepMind pokazał kilka wybranych przykładów klipów wygenerowanych przez Veo 2. Dla AI wyglądają one imponująco – szczególnie dobrze model radzi sobie z trudnymi cieczami, jak syrop klonowy, czy animacją w stylu Pixar. Niemniej jednak technologia wciąż zmaga się z wyzwaniami takimi jak „martwe oczy” postaci czy nieprawidłowe odwzorowanie elementów w tle.

Eli Collins, wiceprezes ds. produktów w DeepMind, przyznał, że nadal jest nad czym pracować. „Spójność i koherencja to obszary wymagające poprawy” – powiedział w rozmowie z TechCrunch. „Veo potrafi utrzymać zgodność z poleceniem przez kilka minut, ale nie radzi sobie z bardziej złożonymi scenariuszami. Podobnie bywa z utrzymaniem spójności postaci.”

Współpraca z twórcami i kreatywny rozwój

DeepMind współpracuje z artystami, aby ulepszać swoje narzędzia do generowania wideo. Firma przyznaje, że w rozwój Veo 2 zaangażowano twórców takich jak Donald Glover, The Weeknd czy d4vd, by lepiej zrozumieć ich proces twórczy.

„Praca z twórcami przy Veo 1 znacząco wpłynęła na rozwój Veo 2. W przyszłości zamierzamy kontynuować współpracę i testy z ich udziałem” – powiedział Collins.

Veo 2 został wytrenowany na ogromnej liczbie klipów wideo, ale DeepMind nie zdradza, skąd dokładnie pochodziły materiały szkoleniowe. YouTube, należący do Google, jest jednym z potencjalnych źródeł, choć firma unika jednoznacznego potwierdzenia. Collins podkreślił, że „Veo zostało wytrenowane na wysokiej jakości parach wideo-opis.”

Nie wszyscy twórcy są zadowoleni z takiego podejścia, szczególnie w kontekście sporów dotyczących wykorzystywania publicznych treści bez zgody autorów. Sprawa ta budzi kontrowersje, zwłaszcza w obliczu obaw o wpływ AI na rynek pracy w branży filmowej i telewizyjnej.

Aby przeciwdziałać ryzyku, Veo 2 korzysta z technologii SynthID, która osadza niewidoczne znaki wodne w generowanych klipach. Jednak, jak przyznaje samo DeepMind, żadna technologia tego typu nie jest całkowicie odporna na manipulacje.

Rozwój narzędzi graficznych

Wraz z premierą Veo 2 Google DeepMind ogłosił również ulepszenia modelu Imagen 3, swojego narzędzia do generowania obrazów. Nowa wersja modelu, dostępna w ImageFX, lepiej radzi sobie z kompozycją, detalami i teksturami, a także oferuje wsparcie dla różnych stylów graficznych, takich jak fotorealizm, impresjonizm czy anime.

Google i DeepMind zdają się wyznaczać nowe standardy w generowaniu treści multimedialnych. Pozostaje jednak pytanie, jak rynek i użytkownicy zareagują na rosnące możliwości i etyczne wyzwania związane z tą technologią.