W świecie, gdzie dane osobowe są nowym złotem, europejski gracz pokazuje, że da się tworzyć sztuczną inteligencję z klasą – i szacunkiem dla prywatności użytkowników. Według najnowszego raportu przygotowanego przez Incogni, to właśnie francuski chatbot Le Chat od Mistral AI okazał się najmniej inwazyjny pod względem prywatności spośród wszystkich analizowanych modeli językowych.

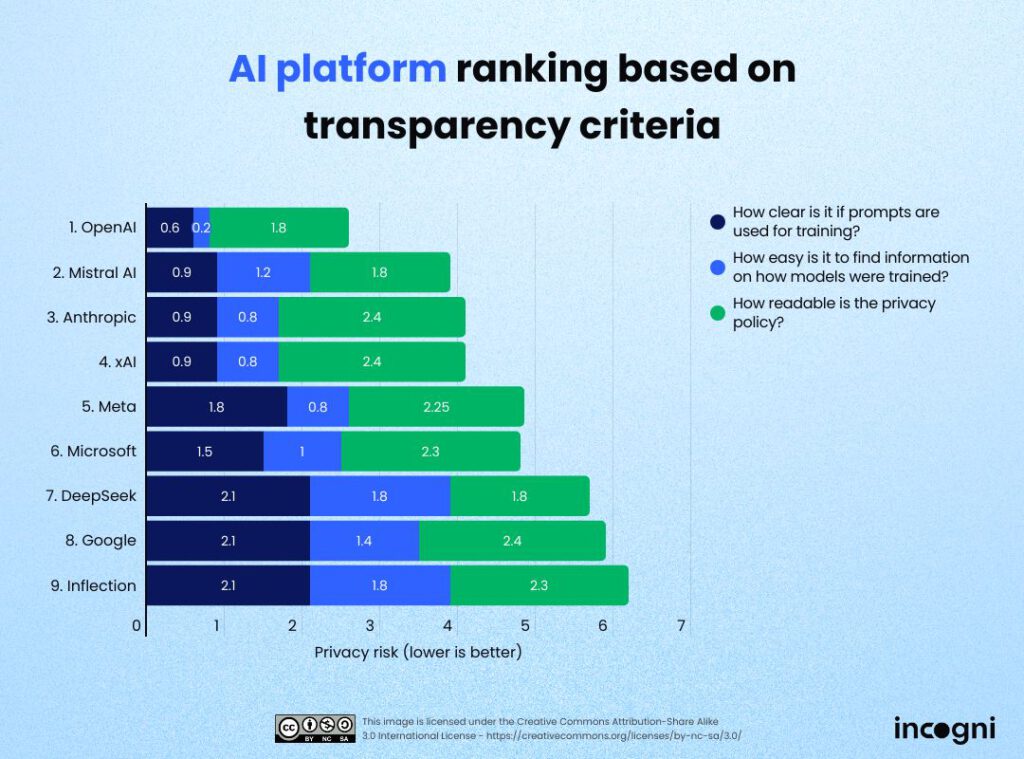

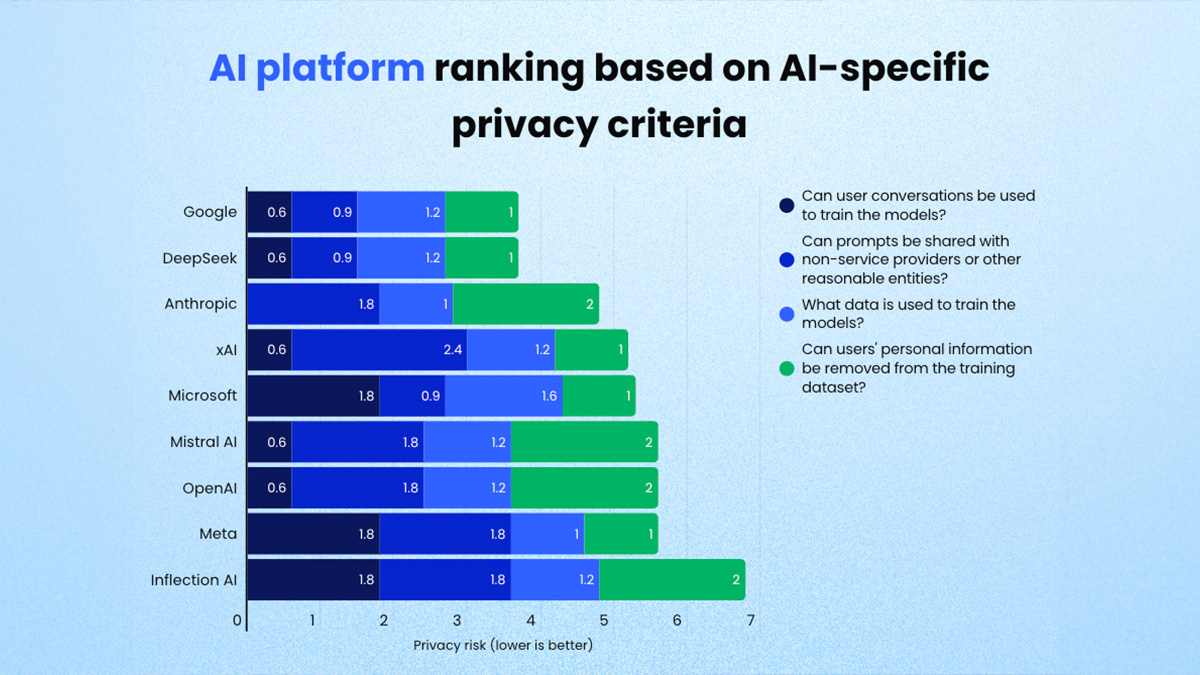

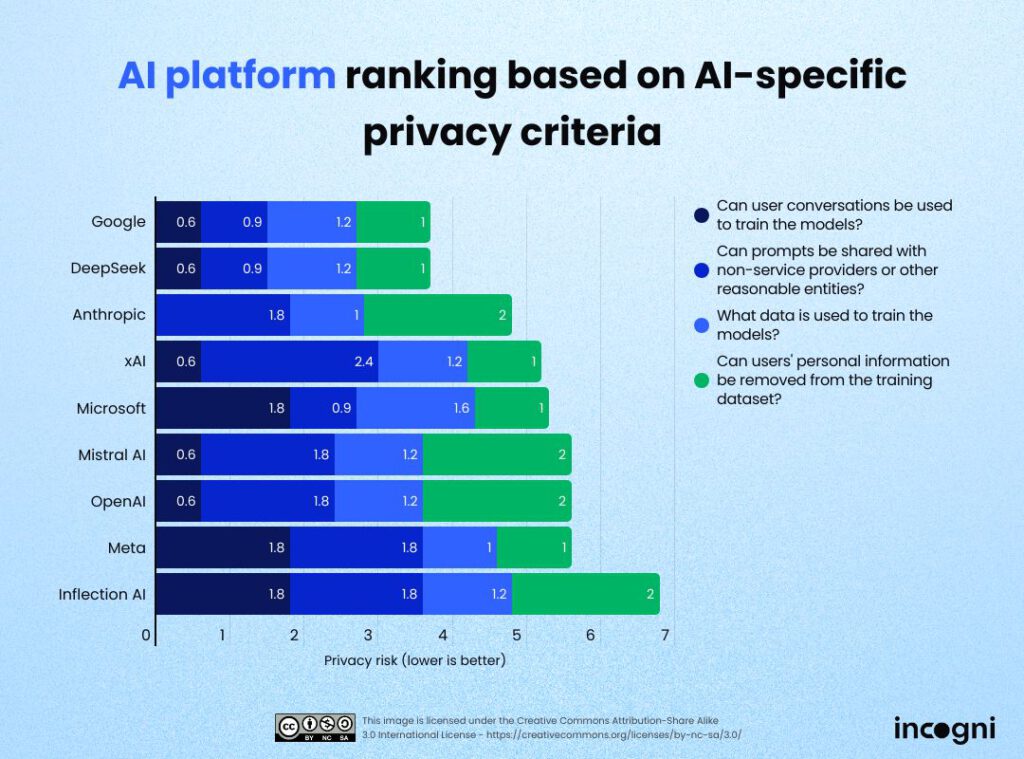

Incogni, firma zajmująca się usuwaniem danych osobowych z sieci, wzięła pod lupę najpopularniejsze generatywne modele sztucznej inteligencji: od ChatGPT OpenAI, przez Claude’a Anthropic, po Groka od Elona Muska. W sumie oceniono dziewięć modeli na podstawie 11 kryteriów – od przejrzystości polityki prywatności, przez sposób zbierania danych, aż po możliwość rezygnacji z udziału w treningu modeli.

Prywatność w punktach – kto zbiera mniej?

Modele otrzymały ocenę od 0 (najlepsza ochrona prywatności) do 1 (najgorsza). W tym zestawieniu Le Chat wypadł najlepiej. Dlaczego? Bo – jak podkreśla raport – francuski chatbot zbiera tylko „ograniczone” dane osobowe i nie dzieli się nimi z firmami trzecimi. Co więcej, Le Chat – obok Pi AI – jest jednym z nielicznych modeli, które nie wykorzystują naszych zapytań do dalszego trenowania.

Na drugim miejscu uplasował się ChatGPT, który – mimo kilku niejasności dotyczących sposobu trenowania modeli – chwalony jest za transparentność i przejrzystą politykę prywatności. Użytkownicy wiedzą, co się dzieje z ich danymi, i to się ceni.

Na trzecim miejscu – Grok od xAI, firmy Elona Muska. Tutaj jednak pojawiły się zastrzeżenia co do ilości zbieranych danych i braku pełnej transparentności. Podobnie wygląda sytuacja z Claude’em od Anthropic.

Technologiczni giganci na szarym końcu

Zdecydowanie gorzej wypadły platformy od największych firm technologicznych. Na końcu listy znajdziemy Meta AI, które według Incogni jest najbardziej inwazyjne. Zaraz za nim uplasowały się Gemini (Google) i Copilot (Microsoft). Wspólny mianownik? Brak możliwości rezygnacji z wykorzystania danych użytkownika w procesie trenowania modelu.

Jakby tego było mało – wszystkie badane modele, bez wyjątku, zbierają dane z tzw. „ogólnodostępnych źródeł”, co może również obejmować dane osobowe. W dobie, gdy granica między „ogólnodostępnym” a „prywatnym” jest cienka jak włos, to szczegół, który warto mieć na uwadze.