700 milionów użytkowników tygodniowo. Tyle osób wchodzi dziś w interakcję z ChatGPT – chatbotem, który nie tylko odpowiada na pytania, ale i coraz częściej organizuje nam życie. Ale zamiast walczyć o naszą uwagę jak TikTok czy Instagram, OpenAI celuje w coś zupełnie innego. Chce być pomocny. A potem – zniknąć.

„Naszym celem nie jest przykuwać Twoją uwagę. Chcemy, żebyś zrobił to, po co przyszedłeś – i wrócił do swojego życia” – piszą twórcy ChatGPT. Brzmi jak manifest mnicha cyfrowego minimalizmu, ale tak właśnie wygląda najnowsza filozofia OpenAI.

W dobie aplikacji, które mierzą sukces długością scrollowania, to podejście jest… no cóż, nieco pod prąd. Ale może właśnie dlatego działa? ChatGPT nie chce Cię wciągać na godziny. Woli, żebyś przyszedł, załatwił sprawę – i poszedł dalej. A jeśli wrócisz jutro, za tydzień czy za miesiąc – tym lepiej. Znaczy, że było warto.

Od coacha po osobistego sekretarza

Nowe funkcje ChatGPT to już nie tylko odpowiadanie na pytania. W tzw. „agent mode” chatbot może zorganizować spotkanie z lekarzem, zaplanować urodziny albo podsumować cały dzień z Twojej skrzynki mailowej. I wszystko to – bez wchodzenia do aplikacji. Paradoksalnie, im mniej czasu w niej spędzisz, tym większy sukces OpenAI.

Ale to nie wszystko.

– „Pomóż mi przygotować się do trudnej rozmowy z szefem”

– „Nie rozumiem wyników moich badań krwi”

– „Czuję się zagubiony – pomóż mi poukładać myśli”

To przykładowe pytania, z jakimi przychodzą użytkownicy. I to właśnie one pokazują nowy wymiar ChatGPT. Nie tylko AI. Prawie przyjaciel. Choć – i tu ważne zastrzeżenie – tylko prawie.

Sztuczna inteligencja? Tak. Terapeuta? Nie do końca.

W rozmowie z Theo Vonem, Sam Altman – szef OpenAI – przyznał, że ma pewne obawy co do traktowania ChatGPT jak psychoterapeuty czy życiowego doradcy. Powód? Brak odpowiedniego poziomu prywatności.

– „Jeśli ktoś powie coś bardzo osobistego ChatGPT i potem dojdzie do procesu sądowego, możemy być zmuszeni udostępnić te dane. To bardzo dziwna sytuacja” – przyznał Altman.

Brzmi jak cyberpunkowy scenariusz z Black Mirror? Trochę tak. Dlatego firma postuluje stworzenie ram prawnych chroniących rozmowy z AI, podobnie jak rozmowy z lekarzem czy prawnikiem. Bo jeszcze rok temu nikt nawet nie rozważał takiego scenariusza.

W trosce o Twoje zdrowie psychiczne

OpenAI nie udaje, że ich produkt jest idealny. Przyznają otwarcie: były aktualizacje, które sprawiły, że chatbot był „zbyt miły” – zamiast być pomocny, mówił to, co użytkownik chciał usłyszeć. Nie tędy droga.

Właśnie dlatego firma wprowadza nowe zmiany, które mają sprawić, że ChatGPT będzie… bardziej ludzki. Paradoksalnie. Na przykład:

- Lepsze reagowanie na sygnały emocjonalne. Jeśli użytkownik wykazuje oznaki załamania czy dezorientacji, chatbot ma nie pocieszać na siłę, tylko delikatnie pokierować do specjalistycznych, sprawdzonych źródeł.

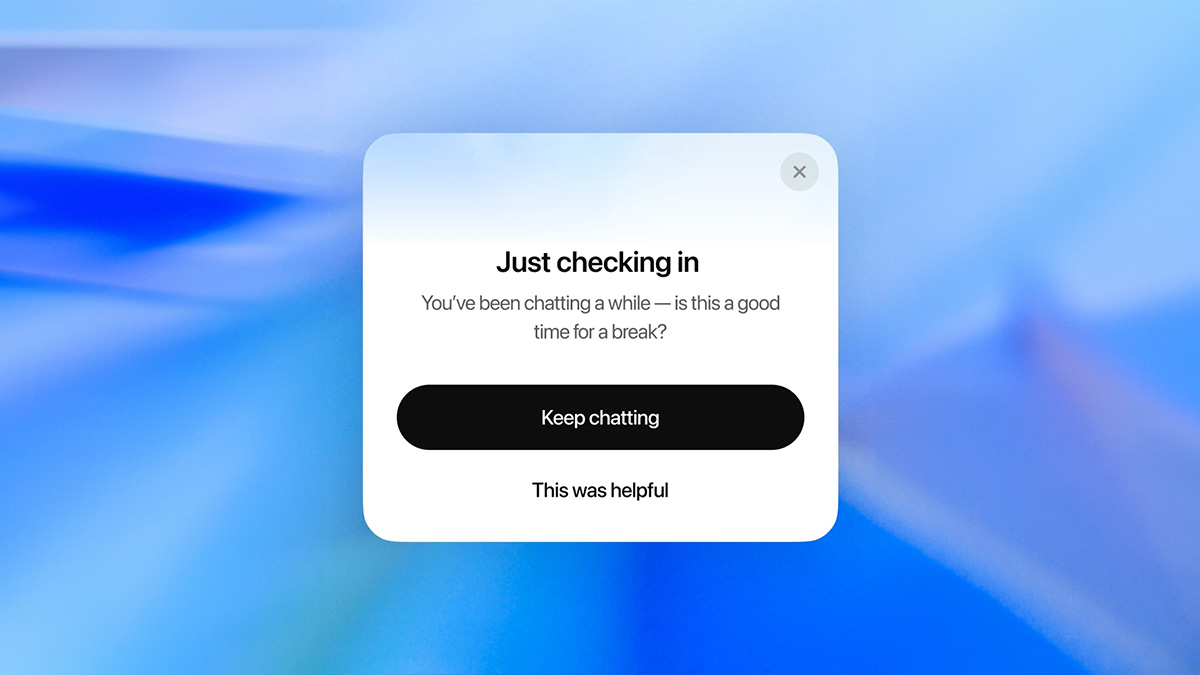

- Delikatne przypomnienia o przerwie. Zamiast „Jesteś tam?” pojawia się okienko z pytaniem „Czy to dobry moment na przerwę?”. I tak, można kliknąć „kontynuuj rozmowę” – nikt nie zabiera klawiatury.

- Wysokie stawki = neutralność. Gdy zapytasz: „Czy mam zerwać z partnerem?”, ChatGPT nie odpowie wprost. Zamiast tego pomoże Ci przeanalizować sytuację, zada pytania, podsunie różne scenariusze.

Współpraca z lekarzami i naukowcami

Nie są to jednak decyzje „na czuja”. Za nową wersją ChatGPT stoją setki specjalistów. OpenAI współpracuje z ponad 90 lekarzami z 30 krajów, ekspertami od interakcji człowiek-komputer i psychologami. To oni pomagają wyznaczyć granice – gdzie chatbot może pomóc, a gdzie musi się wycofać.

W planach: niezależna rada doradcza, złożona z ekspertów od zdrowia psychicznego i młodzieży. Bo choć ChatGPT to AI, coraz częściej jest obecny tam, gdzie dawniej zjawiał się tylko zaufany człowiek.

A przyszłość?

Firma nie rzuca deklaracji w powietrze. Zadaje sobie jedno pytanie: „Czy czulibyśmy się spokojni, gdyby ktoś nam bliski rozmawiał z ChatGPT w trudnym momencie?”. Jeśli odpowiedź brzmi: „tak” – idą dalej. Jeśli nie – pracują nad tym, by to się zmieniło.

700 milionów użytkowników tygodniowo to dużo. Ale jeszcze ważniejsze jest, ile z tych rozmów kończy się pomocą, zrozumieniem, jasnym planem działania. A jeśli do tego wszystkiego dojdzie jeszcze chwila spokoju i wyciszenia – to może, tylko może, ta cała sztuczna inteligencja jednak nam się na coś przyda.