OpenAI właśnie zaprezentowało nową serię modeli AI, które zostały zaprojektowane tak, aby poświęcały więcej czasu na rozwiązywanie problemów przed udzieleniem odpowiedzi. To jakby sztuczna inteligencja zrobiła sobie krótką przerwę na „zastanowienie”, zanim rzuci ostateczne rozwiązanie. I wiecie co? Taki model sprawdza się świetnie w bardziej skomplikowanych dziedzinach jak nauka, kodowanie i matematyka.

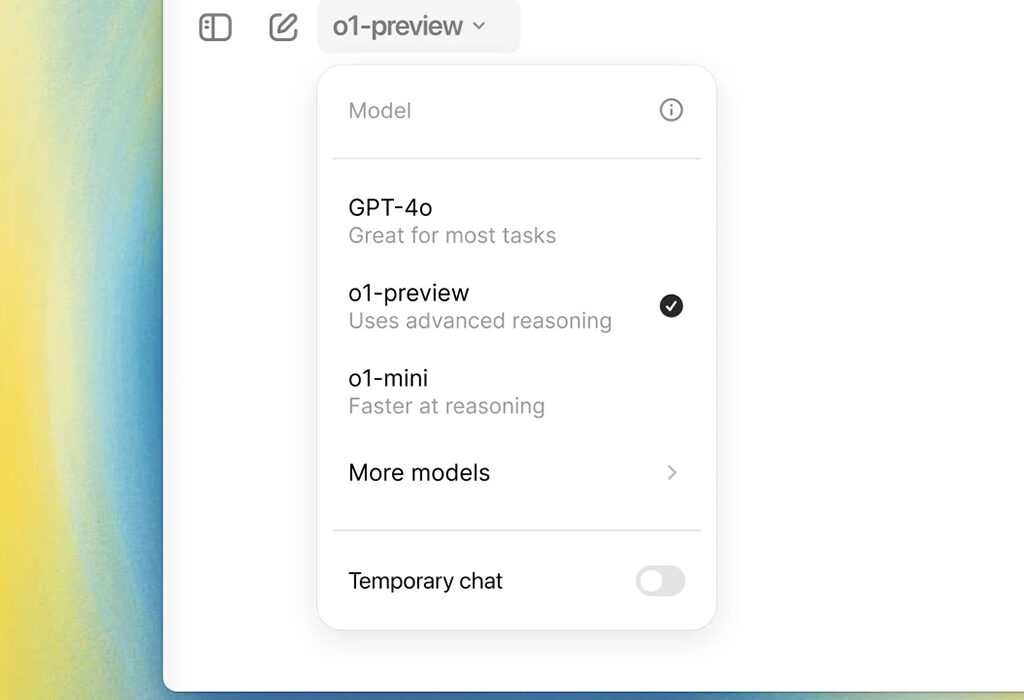

Dziś do ChatGPT oraz API trafia pierwszy model z tej serii. To dopiero przedsmak, ale OpenAI planuje regularne aktualizacje i dalsze usprawnienia. Jednocześnie firma opublikowała ocenę możliwości przyszłej aktualizacji, która jest już w fazie rozwoju.

Modele te zostały przeszkolone, aby poświęcały więcej czasu na przemyślenie problemów przed udzieleniem odpowiedzi, zupełnie jak człowiek. Podczas treningu modele uczą się doskonalić swój proces myślowy, próbować różnych strategii i rozpoznawać własne błędy. Efekt? W testach przyszła aktualizacja modelu osiąga wyniki porównywalne z doktorantami na wymagających zadaniach z fizyki, chemii i biologii. A to nie koniec! Okazuje się, że nowe AI szczególnie dobrze radzi sobie z matematyką i kodowaniem. Podczas kwalifikacji do Międzynarodowej Olimpiady Matematycznej (IMO), model GPT-4o rozwiązał jedynie 13% zadań, a nowy model rozumujący – aż 83%! W zawodach programistycznych na platformie Codeforces wynik wyniósł 89. percentyl. Więcej szczegółów można znaleźć w poście technicznym OpenAI.

Oczywiście, jak na wczesny model przystało, brakuje mu jeszcze wielu funkcji, które czynią ChatGPT tak przydatnym, jak przeglądanie internetu czy wgrywanie plików i obrazów. Na szczęście, w wielu typowych przypadkach GPT-4o będzie miał nad nim przewagę.

Ale jeśli chodzi o zadania wymagające skomplikowanego rozumowania, mamy tu do czynienia z prawdziwym przełomem. Dlatego OpenAI zeruje licznik i nazywa tę serię modeli „OpenAI o1”.

Jak przystało na nową generację AI, OpenAI nie zapomniało o bezpieczeństwie. Stworzono nowy podejście do szkolenia modeli, wykorzystując ich zdolności rozumowania, aby lepiej przestrzegały wytycznych bezpieczeństwa. Dzięki możliwości rozumowania o zasadach bezpieczeństwa w kontekście, modele te mogą skuteczniej je stosować.

Jednym ze sposobów, w jaki OpenAI mierzy bezpieczeństwo, jest testowanie, jak dobrze modele przestrzegają zasad bezpieczeństwa, gdy użytkownik próbuje je obejść (znane jako „jailbreaking”). Na jednym z najtrudniejszych testów GPT-4o uzyskał wynik 22 (w skali 0-100), a model o1-preview aż 84 punkty.

W związku z nowymi możliwościami, firma wzmocniła także swoje działania na rzecz bezpieczeństwa, współpracując z rządem federalnym i opracowując surowsze procedury wewnętrzne. Wspiera to m.in. Ramowy Plan Gotowości, najlepsze w branży zespoły zajmujące się testami bezpieczeństwa oraz przeglądy na poziomie zarządu.

Na potwierdzenie zaangażowania w bezpieczeństwo AI, OpenAI podpisało niedawno umowy z instytutami ds. bezpieczeństwa AI w USA i Wielkiej Brytanii. W ramach tych umów instytuty te uzyskały wcześniejszy dostęp do wersji badawczej nowego modelu, co pomogło ustalić proces badań i testów przyszłych modeli.

Nowe zdolności do rozumowania mogą być szczególnie przydatne dla osób zajmujących się złożonymi problemami z zakresu nauki, programowania, matematyki i pokrewnych dziedzin. Przykładowo, model o1 może być używany przez badaczy w ochronie zdrowia do adnotacji danych z sekwencjonowania komórek, przez fizyków do generowania skomplikowanych formuł matematycznych potrzebnych w optyce kwantowej, czy przez programistów do tworzenia i wykonywania wieloetapowych procesów.

Także, kto by pomyślał – sztuczna inteligencja biorąca chwilę na refleksję, może być przyszłością!